据socialmediatoday报道,毫无疑问,视觉元素是下一代数字体验的主要焦点,但同时音频在实现完全沉浸式交互方面也发挥着关键作用,声音有助于传达思维,并使虚拟环境栩栩如生。

而这便是Meta最新研究的切入点——为了促进更逼真的AR和VR体验,Meta正在开发全新空间音频工具,以响应不同视觉环境。

正如视频所呈见,Meta的工作围绕人们期望在特定环境中体验到的声音的共性,以及如何将其转化为数字领域而展开。

Meta解释道:“无论是元宇宙派对,还是通过AR眼镜观看家庭影院,声学在其中都扮演着重要的角色……我们设想未来人类都将戴着AR眼镜重温全息回忆,无论他们身处何地,全息环境下的影像与声音体验都将完全同步一致,不仅如此,当人们娱乐元宇宙游戏时,除了视觉、听觉感受也能丰富和增强沉浸感。”

显然,声音将使元宇宙体验更加身临其境,并将发挥着超出预期的效果作用。

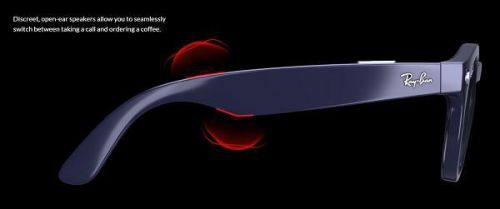

Meta第一代Ray-BanStories眼镜在某种程度上已经考虑到了这一点,从而采用了将声音直接传递至耳朵的扬声器设计,该设计时尚且实用,而扬声器的位置使得用户无需耳塞即能实现沉浸式音频体验。

为了将其沉浸式音频元素提升到下一个阶段,Meta向开发者开放了三种用于视听理解的新模型。

“这些模型专注于人类语言和声音,旨在以更快的速度将我们推向更加身临其境的现实。”

Meta已经开发了专门的视听匹配模型,如视频剪辑所述,将这项研究扩展至更多开发者和音频专家,则可以帮助Meta构建更逼真的音频转化工具。

Meta首席执行官扎克伯格指出,“在打造元宇宙内容的过程中,空间音频将是令人惊叹的重要因素之一,我很期待该技术的发展。”