编者按:尽管去年 Meta 收入首次出现了下降,尽管遭遇了通货膨胀和经济低迷,但该公司仍义无反顾地对元宇宙押下重注。那么,他们的努力都收到了什么成效?这些项目是不是都能实现? Meta 这场实现虚拟世界愿景的持久战究竟能坚持多久?这一切都隐藏在那个绝密的现实实验室的背后,我们就来看看里面都有什么吧。文章来自编译。

马克·扎克伯格就坐在我对面,用手指的轻微运动控制着屏幕上的物体。轻敲,滑动,捏合。他的手腕戴着一块粗大的腕表,看起来很像一块实验性的智能手表:这就是 Meta 对我们未来与 AR、VR、计算机以及其他一切互动的愿景。

就在准备演示这款神经腕带之前,扎克伯格说:“它跟智能眼镜配合得很好......其实我觉得它适合一切。我认为在未来,人们会用它来控制自己的手机和电脑,以及其他东西......你只需要带上一条腕带。”他的手和手指的动作似乎很轻微,几乎像是一动不动,有时几乎都看不见。

神经输入设备只是 Meta 除了 VR 以外的战略的一部分,而这些腕带是我第一次访问位于华盛顿州雷德蒙德的 Meta Reality Labs 总部时看到和试过的技术之一。此番探访是 Meta 第一次邀请记者参观其未来的技术研究设施,这些设施就坐落在 Facebook 硅谷总部以北的几座不起眼的办公楼内。

位于华盛顿州雷德蒙德的 Meta Reality Labs 入口。

上次拜访雷德蒙德时,我试用了微软的 HoloLens 2。我的 Meta 之旅也有类似的经历。这一次,我试用的是 Meta Quest Pro,这是一款将 VR 和 AR 融合到一台设备之内的头戴设备,扎克伯格要靠它去推动自己的雄心壮志,实现更聚焦于工作的元宇宙战略。

Meta 最新的 Connect 大会新闻主要的关注点还是 Quest Pro,以及与微软、Zoom、Autodesk 和埃森哲等公司建立的新的工作伙伴关系,目标是让 Meta 与微软的混合现实雄心珠联璧合。

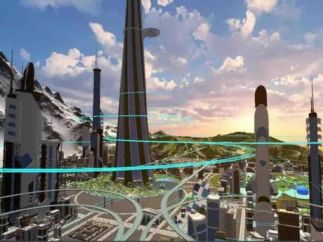

我还得看看他们的一些实验性研究项目。虽然这些项目还没有为日常使用做好准备,但可展示 Meta 下一步计划的确切目标。这些还很遥远的项目,以及更昂贵的 Quest Pro 头戴设备,它们的出现在对于 Meta 来说是一个奇怪的时刻,这家公司已经投入数十亿美元到元宇宙的未来,但其最受欢迎的 VR 头戴设备 Quest 2 的销量仍然不到 2000 万。感觉未来还没有完全到来,但像 Meta 这样的公司已经为此做好了准备。

我与其他几位受邀记者一起体验了若干离奇古怪的演示。那感觉就像我在探索威利·旺卡(Willy Wonka)的巧克力工厂。但我也得到了这样的信息,即虽然 Quest Pro 看似是 Meta 硬件走向新方向的开端,但它离最终目标还很遥远。

Meta Reality Labs Research ,研究人员在演示用EMG 腕带测量运动神经元

神经输入:会适配人的腕带

Meta Reality Labs 的首席科学家 Michael Abrash 一遍又一遍地告诉我这个词:“协同适应性学习” 。他说的是 Meta 自 2019 年收购 CTRL-Labs 以来曾多次讨论过的那款腕带。这是一个很难理解透彻的概念,但在几位训练有素的研究人员的展示下,我总算对此有所了解。戴着连接到电脑的笨重腕带,佩戴者只需动动手指,即可让卡通人物在无休止的游戏里面来回走动。然后,他们的动作似乎停止了。他们的动作如此轻微,以至于他们的手看起来几乎都没有动,但他们其实还在玩着游戏。这款腕带用 EMG(肌电图,对肌肉的电测量)来检测细微的肌肉冲动。

Reality Labs 神经运动接口总监, CTRL-Labs 前首席执行官 Thomas Reardon 在此次演示中发表了演讲。他表示,基于反馈的训练过程可以逐步让腕带佩戴者减小动作幅度,最终可以只用一个运动神经元。最终结果看起来有点像读心术,但其实是通过巧妙地测量展现运动意图的电脉冲来完成的。

马克·扎克伯格用电脑演示一种神经输入腕带

扎克伯格在展示腕带的时候,用了一组类似的动作,也很轻微,但更明显。腕带的控制感觉与基于触摸的触控板或空中鼠标(air mouse)有点类似,能够识别靠压感的捏合、滑动和手势。

在描述 EMG 和神经输入技术的目标时,Abrash 表示:“从长远来看,我们希望能有一个像与物理世界打交道一样自然和直观的界面。”

打字如何实现还没有出来。根据扎克伯格的说法,要达到能正常打字的速度和保真度需要更高的带宽:“现在比特率低于快速打字的频率,但首要任务是先得让技术可行。”到了一点时候,目标是让控制能做更多的事情。 Meta 认为这项技术可能需要五到六年的时间才能面世,感觉就太久了。但如果这个时间框架保持不变的话,它可能会与 Meta 预计的最终定型版 AR 眼镜一起面世。

EMG 腕带看起来像一块巨大的智能手表原型,那一段段的表带内置了传感器。

扎克伯格说,腕带是智能眼镜的关键,因为我们不想把控制器随时带在身边,而语音和手势跟踪还不够好。但最终他计划让这些类型的控制完全适用于任何设备,不管是 VR 还是其他设备都能识别。

这些控制看起来会牵涉到一种完全不同类型的输入语言,可能与手机或 VR 控制器上的现有控制相似,但会逐步适配人的行为。人们似乎需要一段时间才能学会使用它。

Reardon 说:“大多数人都会知道很多关于控制上的事情,比方说如何在这个世界进行互动,如何移动自己的身体等。他们会理解简单的系统,比如字母。那就是我们的契合点,然后我们做这件事,这个非常深度的思想叫做共同适应,按照这个想法,人与机器将携手并进,沿着通往我们的目标之路共同学习,这个目标我们称之为纯神经界面。我们会利用神经运动接口将神经解码与运动解码融合到一起。与其说这是一种新的语言,不如说这种语言会在机器和人之间进化,但它的开端是人们今天所做的事情。”

演示反馈如何会让腕带感知到幅度越来越小的运动。

扎克伯格补充道:“共同适应这个东西很有深度。你没法与物理键盘共同适应。移动键盘的话有涉及一点点共同适应,比如你出现了一点拼写错误也没问题,它会预测 [你想输入的单词],但共同适应远不止于此。”

我自己没有戴上或试过神经输入腕带,但我能看别人是怎么用的。几年前,在 CES 上,我确实略为上手过一种不同类型的腕戴式神经输入设备,对此类技术的实际工作原理算是有了一点感受。它与我一年前试过的 Nextmind (后被 Snap 收购)的头戴式设备不同,后者是用大脑信号来衡量眼球运动。

使用 Meta 腕带的人似乎很容易就能做出动作,但那些都是基本的滑动游戏控制。这种控制设备如何才能配合 AR 眼镜执行更关键的日常使用? Meta 还没做出来这种效果:根据扎克伯格的说法,目前的目标是让技术能用,并展示自适应学习如何可以逐步缩小反应的动作幅度。我们可能需要一段时间才能在日常设备上看到这项技术,但我想知道的是, Meta 怎么将这些原理应用到不是基于神经输入,而是靠机器学习辅助的那种控制上。在最终目标实现之前,我们能看到改进的控制器或手势跟踪组合吗?很难说。但这些腕带目前还是很遥远的赌注,不具备指日可待的可能性。

戴着一个支持空间追踪的头戴设备,我分辨不出它制造的音效与房间里的扬声器的区别。

超真实的 3D 音频

我尝试的第二组演示,展示了下一代的空间音频,其实就是 Meta 在 2020 年谈到过的研究——该公司原先计划在疫情爆发之前做现场展示的。空间音频已广泛用于 VR 头戴设备、游戏机和 PC 以及各种日常耳机,如 AirPods 的上面。 Meta 打算做的不仅仅是让音频看起来似乎来自不同方向,而是以让它看起来像是真的来自你自己房间的方式传播声音。

我们去参观了该实验室的隔音消声室,那是一个带有泡沫墙的悬挂空间,可以阻挡声波的反射。对方向我们展示了一系列的音箱,那是用来帮助研究声音是如何传播到人的耳朵,并探索声音在物理空间的运动方式的。之后,我们体验了两个展示声音的真实感的演示。

在 Meta 的消声室内,他们用了一系列的音箱帮助制造空间音频。

其中一个演示是我坐在拥挤的房间里,耳朵戴上麦克风,然后项目负责人在我周围走动,演奏乐器并在不同距离发出声音。录制了 40 秒之后,项目负责人用头戴式耳机给我回放了那段音频……里面有些地方听起来就像有人在房间里面我的周围走动一样。我认为,这种效果之所以令人信服是因为音频回声:运动在房间的空间里面产生的那种回荡的感觉。

第二个演示我是在一个放有四个音箱的房间里面。他们让我戴上一副 3D 空间追踪耳机,然后确定听到的音乐是来自音箱还是我的耳朵。我失败了。音乐的播放似乎毫无瑕疵,我在逛来逛去的时候不得不摘下耳机来确认声音的来源。

按照 Michael Abrash 在 2020 年的说法,这项技术不像神经腕那样,距离成为现实还很遥远。 Meta 的计划是在手机摄像头的帮助下,对 3D 音频做出个性化的调整,就像苹果刚刚给最新的 AirPods 增加的特性一样,但多了一项逼真的房间映射的额外好处。 Meta 的目标是最终让出现在任何空间内 AR 投影听起来都令人信服:这个目标是很有意义的。一个由全息物体组成的世界需要给人以与现实锚定的感觉。尽管,如果未来的虚拟对象听起来感觉像我试过的演示一样令人信服的真实的话,那真实声音和虚拟声音可能就很难区分,这会引起一大堆别的存在主义的问题。

戴着 VR 头显,与电脑屏幕上的头像说话:与虚拟角色的对话太逼真了,以至于感觉就像和他们在同一个房间里面一样。

与逼真得像照片一样的头像交谈

我站在一个黑暗的空间里,戴上特制的面部追踪 VR 头显,我对面出现了一张似乎被烛光照亮的非常逼真的脸庞,但其实那人身处 Meta 位于匹兹堡的 Reality Labs Research 办公室。我正在体验 Codec Avatars 2.0,它憧憬的是一个关于虚拟世界中的化身如何变得逼真的未来。

究竟有多逼真?很逼真。逼真到不可思议:我站得很近,看着对方嘴唇的动作、他的眼睛、他的微笑和皱眉。感觉就像和一个超级逼真的 PlayStation 5 游戏角色交谈,然后一遍又一遍地意识到这是与真人的实时对话,以虚拟形象的形式进行。

我想知道面部跟踪到底有多好或局限性有多大:毕竟,我早期试用 Quest Pro 的时候就发现了用面部跟踪的局限性。我让对面的 Jason 的虚拟角色做出各种表情,他照做了。他说我是个话痨,这让我发笑。环境的亲密性让我感觉我必须靠近一点交谈,那感觉就像在山洞或昏暗的酒吧里一样。我想就有那么逼真吧。最终,这种逼真感觉开始好到以至于我认为自己在进行真正的对话了。感觉就像我在自己的视频游戏的过场动画里面一样。

不过 Meta 并不认为这会很快应用到日常的头戴设备上。首先,独立的 VR 头显的处理能力有限,房间里面的头像越多,图形处理的负担就越重。此外,跟踪技术还不适用所有人。

尝试与与一个Instant Codec Avatar聊天,用手机扫描人脸即可创建出来的。

我尝试的第二个演示有一个更精简版,上面展示了一个头像,它是通过用名为 Instant Codec Avatars 的新技术,通过手机摄像头进行面部扫描创建出来的。这张脸看起来比我自己用过的大多数扫描都要好。但我感觉自己只是在跟一个僵硬的、只能轻微移动的头像说话。最终的结果不如 Meta 现在使用的卡通化皮克斯式的头像那么流畅。

用一系列摄像机对一位演员提前进行 3D 扫描。我看到之后渲染的化身被叠加了一层数字服装。

最后一个演示展示的是一个全身的化身(从头到脚!),但不是直播的或交互式的。得先用一系列摄像机在一个特殊的房间对演员预先进行 3D 扫描。这项演示的目的是展示如何将数字化衣服逼真地披在化身上。从近距离看结果相当不错,但效果与逼真的视频游戏类似。他们似乎是在试水有朝一日在虚拟世界里面如何出售数字资产,但当前任何一款头戴设备都还不支持这种。

我的运动鞋用 Meta 新的捕捉技术进行了 3D 扫描,只需要手机即可。

对我的鞋子进行3D 扫描(还有超逼真的仙人掌和泰迪熊)

就像魔术表演里面的志愿者一样,我被要求脱下一只鞋子进行 3D 扫描实验。我的鞋子最后被放到桌子上,只需用手机摄像头扫描——不需要激光雷达。大约半小时后,我就可以开始用 AR 和 VR 看自己的鞋里。与空间音频一样,3D 扫描已经很普遍,有很多专门做将 3D 资产导入 VR 和 AR的公司。 Meta 的研究目标是用一种所谓的神经辐射场(neural radiance fields)技术,从而让各种手机摄像头扫描也能取得更好的结果。另一个演示将保真度又提高了一个档次。

我的鞋被扫描后 AR显示的效果。

有几个东西是预先扫描好的,显然需要几个小时才能准备好,它们捕捉到了复杂 3D 物体的光模式。在VR头显设备上看到的结果给人留下了非常深刻的印象,包括一只泰迪熊,几颗仙人掌等的细节非常逼真。卷曲的皮毛似乎不像大多数 3D 扫描那样融合到一起或呈磨砂装;相反,呈现出来的效果是蓬松的,似乎没有角度。仙人掌上的刺纤毫毕现。

在我在 Reality Labs 尝试过的所有演示当中,这也许是最不能令人叫绝的。但这仅仅是之前已经在 AR 和 VR 演示中有了许多令人印象深刻的 3D 扫描和渲染的体验。目前还不清楚Meta 的研究示例在日常当中实现起来的实时性或容易程度如何,所以很难判断该功能的有效性。可以肯定的是,如果将对象扫描成文件兼容的虚拟版变得更加容易的话,那就将成为任何公司实现统治虚拟世界这个野心的关键。大量企业已经瞄准了线上销售虚拟商品,下一步是让任何人都可以轻松地对自己的东西做这件事。同样,这个也已经有在手机上使用的可能,只是看起来还没有那么好……还差点火候。

首席科学家Michael Abrash 在一堆VR 和 AR 原型头显前与我们交谈。

这一切意味着什么呢?

当我结束在 Meta 一天的参观,在停车场去打 Lyft 时,我脑海里面浮现的一个更大的疑问,是这一切汇总起来意味着什么呢? Meta 拥有全新的 Quest Pro 头戴设备,这是一款将 AR 和 VR 融为一体的尖端设备,它为通过面部跟踪控制头像提供了新的可能性。

未来的其余部分仍然是一系列的问号。 Meta 野心勃勃,想要在元宇宙开疆拓土,但通往那些地方的道路都还没有铺设完毕。神经输入、AR 眼镜、声音、物体和体验的虚实融合?这些可能还需要几年的时间。

尽管去年Meta 收入出现了下降,尽管遭遇了通货膨胀和经济低迷,但该公司仍义无反顾地对元宇宙押下重注,这些项目是不是都能实现? Meta 这场实现虚拟世界愿景的持久战究竟能坚持多久?

Meta 的VR 太阳镜原型,是该技术的“北极星”目标。

一天参观结束,当我们再度聚在一起时,Abrash 又一次把我们带回到同一个主题,即沉浸式计算最终会成为一场真正的革命。早些时候,我们曾在了一堵挂满了 VR 和 AR 头显的墙边驻足,这是 Meta 制作的所有实验原型的奖杯陈列柜。我们看到了有混合现实的,有的则是连着显示器,旨在展示看到的外部的样子,还有的非常小,似乎是要成为太阳镜一样的梦想 VR 设备。

这让我想到了智能手机进入主流之前走过的手机设计实验的漫长道路。显然,元宇宙的未来仍在路上。虽然现在大事物可能正在出现,但 AR 和 VR 未来真正的“智能手机”在很长一段时间内可能都不会出现。

站在头显陈列墙上,Abrash 说道:“有一点我非常确定,那就是 20 年后,这将是我们互动的方式。它将以我们以前从未做过的方式去做事情。但它的真正问题是,要做到这一点非常非常困难。”

延伸阅读:

一年过去了,扎克伯格进军元宇宙的努力究竟出了什么问题?